Véhicule autonome Uber : le choix qui tue

Catégorie: 3D, A l'actu, Entreprises, Matériel/GPS, Mobilité, Réseaux/Transports

Pourquoi le véhicule autonome test d’Uber a-t-il heurté un piéton mi-mars ? Défaut de capteur ? Dilemme éthique ? Non, il a juste opté pour une conduite fluide.

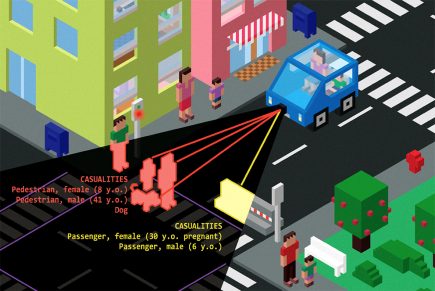

Le dilemme éthique de la voiture autonome ? Le sujet est passionnant et avait passionné les participants à DécryptaGéo 2017, quand Jean-François Bonnefon avait présenté les travaux menés dans le cadre du projet de recherche Moral Machine. On n’en est pas encore là semble-t-il. Après analyse, le véhicule test Uber qui a tué une femme alors qu’elle traversait la route en tenant son vélo le 19 mars au soir en Arizona n’a pas choisi entre une femme âgée et deux jeunes bambins pleins de vie ou un PDG plein aux as, non… il a juste choisi de rouler sans à-coups !

Faux positif

En effet, malgré la pénombre, les capteurs ont bien détecté la présence d’un obstacle, nous apprend un article récemment paru dans Information. Mais le logiciel de traitement l’a rangé dans la catégorie des sacs plastiques volants et autres objets sans danger, n’entraînant, de fait, pas de réaction de la part du système de freinage d’urgence. C’est tout le problème du réglage des détections que pose ce premier accident mortel sur un piéton. Combien de pixels anormaux faut-il pour que soit identifiée une forme dangereuse pour la conduite ? Si le seuil est trop bas, la conduite sera trop hachée en raison du nombre trop important de faux négatifs. S’il est trop haut, la conduite est plus agréable, mais le piéton mal éclairé est en danger. Mais qui voudrait d’un véhicule autonome qui donne de grands coups de freins à chaque papier gras ? Une enquête est en cours avec la National Transportation Safety Board, mais le sujet ne concerne pas qu’Uber, loin de là, comme l’ont analysé les journalistes de MIT Tech review.

En effet, malgré la pénombre, les capteurs ont bien détecté la présence d’un obstacle, nous apprend un article récemment paru dans Information. Mais le logiciel de traitement l’a rangé dans la catégorie des sacs plastiques volants et autres objets sans danger, n’entraînant, de fait, pas de réaction de la part du système de freinage d’urgence. C’est tout le problème du réglage des détections que pose ce premier accident mortel sur un piéton. Combien de pixels anormaux faut-il pour que soit identifiée une forme dangereuse pour la conduite ? Si le seuil est trop bas, la conduite sera trop hachée en raison du nombre trop important de faux négatifs. S’il est trop haut, la conduite est plus agréable, mais le piéton mal éclairé est en danger. Mais qui voudrait d’un véhicule autonome qui donne de grands coups de freins à chaque papier gras ? Une enquête est en cours avec la National Transportation Safety Board, mais le sujet ne concerne pas qu’Uber, loin de là, comme l’ont analysé les journalistes de MIT Tech review.

Communiqués

Communiqués